Más sobre ciencia de datos en: cienciadedatos.net

- Regresión lineal con Python

- Regresión lineal múltiple con Python

- Regresión logística con Python

- Regularización Ridge, Lasso y Elastic Net con Python

- Machine learning con Python y Scikitlearn

- Árboles de decisión con Python: regresión y clasificación

- Random Forest con Python y Scikit-learn

- Gradient Boosting con Python y Scikit-learn

- Gradient Boosting probabilístico con Python

- Máquinas de Vector Soporte (SVM)

- Redes neuronales con Python

- Análisis de componentes principales PCA

- Clustering

- Detección de anomalías con PCA

- Detección de anomalías con autoencoders

- Detección de anomalías con Gaussian Mixture Models

- Detección de anomalías con Isolation Forest

- Análisis de texto (text mining) con Python

- Reglas de asociación

- Análisis Tweets con Python

Introducción¶

Un modelo Random Forest está formado por múltiples árboles de decisión individuales. Cada uno de estos árboles es entrenado con una muestra ligeramente diferente de los datos de entrenamiento, generada mediante una técnica conocida como bootstrapping. Para realizar predicciones sobre nuevas observaciones, se combinan las predicciones de todos los árboles que conforman el modelo.

Muchos métodos predictivos generan modelos globales en los que una única ecuación se aplica a todo el espacio muestral. Cuando el caso de uso implica múltiples predictores, que interaccionan entre ellos de forma compleja y no lineal, es muy difícil encontrar un único modelo global que sea capaz de reflejar la relación entre las variables. Los métodos estadísticos y de machine learning basados en árboles engloban a un conjunto de técnicas supervisadas no paramétricas que consiguen segmentar el espacio de los predictores en regiones simples, dentro de las cuales es más sencillo manejar las interacciones. Es esta característica la que les proporciona gran parte de su potencial.

Los métodos basados en árboles han ganado reconocimiento como una referencia en el ámbito de la predicción debido a los excelentes resultados que ofrecen en una amplia gama de problemas. En este documento se explora cómo se construyen y utilizan los modelos Random Forest.

✎ Nota

Es importante conocer el funcionamiento de los árboles de decisión para poder comprender los modelos Random Forest. También es recomendable conocer los modelos Gradient Boosting, que comparten muchas carácteristicas con Random Forest.Ventajas

Son capaces de seleccionar predictores más relevantes de forma automática.

Pueden aplicarse a problemas de regresión y clasificación.

Los árboles pueden, en teoría, manejar tanto predictores numéricos como categóricos sin tener que crear variables dummy o one-hot-encoding. En la práctica, esto depende de la implementación del algoritmo que tenga cada librería.

Al ser métodos no paramétricos, no requieren que los datos sigan una distribución específica.

Por lo general, necesitan menos limpieza y preprocesamiento de datos en comparación con otros métodos de aprendizaje estadístico. Por ejemplo, no requieren estandarización.

Son menos susceptibles a ser influenciados por valores atípicos (outliers).

Si el valor de un predictor no está disponible para una observación, aún se puede realizar una predicción utilizando las observaciones del último nodo alcanzado. La precisión de la predicción se verá reducida pero al menos podrá obtenerse.

Son muy útiles en la exploración de datos, permiten identificar de forma rápida y eficiente las variables (predictores) más importantes.

Gracias al Out-of-Bag Error, es posible estimar el error de validación sin recurrir a estrategias computacionalmente costosas como la validación cruzada. Esto no aplica en el caso de series temporales.

Son adecuados para conjuntos de datos con un gran número de observaciones, demostrando una buena escalabilidad.

Desventajas

La combinación de múltiples árboles reduce la capacidad de interpretación en comparación con modelos basados en un solo árbol.

Al tratar con predictores continuos, se puede perder parte de la información al categorizarlos durante la división de los nodos.

La técnica de recursive binary splitting utilizada para crear las ramificaciones de los árboles puede favorecer a los predictores continuos o cualitativos con muchos niveles, ya que tienen una mayor probabilidad de contener un punto de corte óptimo por azar.

Tal y como se describe más adelante, la creación de las ramificaciones de los árboles se consigue mediante el algoritmo de recursive binary splitting. Este algoritmo identifica y evalúa las posibles divisiones de cada predictor acorde a una determinada medida (RSS, Gini, entropía…). Los predictores continuos o predictores cualitativos con muchos niveles tienen mayor probabilidad de contener, solo por azar, algún punto de corte óptimo, por lo que suelen verse favorecidos en la creación de los árboles.

No son capaces de extrapolar fuera del rango observado en los datos de entrenamiento.

Random Forest en Python

Existen múltiples implementaciones de modelos Random Forest en Python, siendo una de las más utilizadas es la disponible en scikit-learn. Aunque es menos conocido, las principales librerías de Gradient Boosting como LightGBM y XGBoost también pueden configurarse para crear modelos Random Forest. Todas ellas están muy optimizadas y se utilizan de forma similar, sin embargo, presentan diferencias en su implementación que pueden conducir a resultados distintos. En scikit-learn, es necesario aplicar one-hot-encoding a los predictores categóricos, cosa que no es necesaria en LightGBM y XGBoost. Esto incide directamente en la estructura de los árboles generados y, por consiguiente, en los resultados predictivos del modelo y en la importancia atribuida a los predictores (consultar detalles más adelante).

✎ Nota

A partir de la version1.4, los modelos RandomForest de scikit-learn soportan valores ausentes.

Random Forest¶

Un modelo Random Forest está compuesto por un conjunto (ensemble) de árboles de decisión individuales. Cada uno de estos árboles es entrenado con una muestra aleatoria extraída de los datos de entrenamiento originales mediante bootstrapping). Esto implica que cada árbol se entrena con un conjunto de datos ligeramente diferente. En cada árbol individual, las observaciones se distribuyen a través de bifurcaciones (nodos), dando forma a la estructura del árbol hasta llegar a un nodo terminal. La predicción de una nueva observación se obtiene al agregar las predicciones de todos los árboles individuales que conforman el modelo.

Para comprender cómo funcionan los modelos Random Forest es fundamental familiarizarse primero con los conceptos de ensemble y bagging.

Métodos de ensemble¶

Todos los modelos de aprendizaje estadístico y machine learning enfrentan el desafío del equilibrio entre sesgo y varianza.

El término "sesgo" (bias) se refiere a cuánto se desvían en promedio las predicciones de un modelo con respecto a los valores reales. Refleja la habilidad del modelo para capturar la verdadera relación entre los predictores y la variable de respuesta. Por ejemplo, si la relación sigue un patrón no lineal, un modelo de regresión lineal, independientemente de cuántos datos se disponga, no podrá modelar adecuadamente la relación y tendrá un sesgo alto.

Por otro lado, el término "varianza" hace referencia a cuánto cambia el modelo en función de los datos utilizados en su entrenamiento. Idealmente, un modelo no debería cambiar demasiado ante pequeñas variaciones en los datos de entrenamiento. Si esto ocurre, indica que el modelo está memorizando los datos en lugar de aprender la verdadera relación entre los predictores y la variable de respuesta. Por ejemplo, un modelo de árbol con muchos nodos tiende a cambiar su estructura incluso con pequeñas variaciones en los datos de entrenamiento, lo que indica que tiene alta varianza.

Conforme aumenta la complejidad de un modelo, este dispone una mayor flexibilidad para adaptarse a las observaciones, lo que conlleva una reducción del sesgo y una mejora en su capacidad predictiva. Sin embargo, una vez alcanzado un cierto nivel de complejidad, surge el problema del sobreajuste (overfitting). Este fenómeno se presenta cuando el modelo se ajusta tanto a los datos de entrenamiento que es incapaz de predecir correctamente nuevas observaciones. El modelo óptimo es aquel que logra encontrar un equilibrio adecuado entre sesgo y varianza.

¿Cómo se controlan el bias y varianza en los modelos basados en árboles? Por lo general, los árboles pequeños, con pocas ramificaciones, tienden a tener poca varianza pero pueden no captar de manera precisa la relación entre las variables, lo que se traduce en un alto sesgo. Por otro lado, los árboles grandes se ajustan mucho a los datos de entrenamiento, lo que reduce el sesgo pero incrementa la varianza. Una forma de solucionar este problema son los métodos de ensemble.

Los métodos de ensemble combinan múltiples modelos en uno nuevo con el objetivo de lograr un equilibro entre bias y varianza, consiguiendo así mejores predicciones que cualquiera de los modelos individuales originales. Dos de los tipos de ensemble más utilizados son:

Bagging: Se ajustan múltiples modelos, cada uno con un subconjunto distinto de los datos de entrenamiento. Para predecir, todos los modelos que forman el agregado participan aportando su predicción. Como valor final, se toma la media de todas las predicciones (variables continuas) o la clase más frecuente (variables categóricas). Los modelos Random Forest están dentro de esta categoría.

Boosting: Se ajustan secuencialmente múltiples modelos sencillos, llamados weak learners, de forma que cada modelo aprende de los errores del anterior. Como valor final, al igual que en bagging, se toma la media de todas las predicciones (variables continuas) o la clase más frecuente (variables cualitativas). Tres de los métodos de boosting más empleados son AdaBoost, Gradient Boosting y Stochastic Gradient Boosting.

Aunque el objetivo final es el mismo, lograr un balance óptimo entre bias y varianza, existen dos diferencias importantes:

Forma en que consiguen reducir el error total. El error total de un modelo puede descomponerse como $bias + varianza + \epsilon$. En bagging, se emplean modelos con muy poco bias pero mucha varianza, agregándolos se consigue reducir la varianza sin apenas inflar el bias. En boosting, se emplean modelos con muy poca varianza pero mucho bias, ajustando secuencialmente los modelos se reduce el bias. Por lo tanto, cada una de las estrategias reduce una parte del error total.

Forma en que se introducen variaciones en los modelos que forman el ensemble. En bagging, cada modelo es distinto del resto porque cada uno se entrena con una muestra distinta obtenida mediante bootstrapping). En boosting, los modelos se ajustan secuencialmente y la importancia (peso) de las observaciones va cambiando en cada iteración, dando lugar a diferentes ajustes.

La clave para que los métodos de ensemble consigan mejores resultados que cualquiera de sus modelos individuales es que, los modelos que los forman, sean lo más diversos posibles (sus errores no estén correlacionados). Una analogía que refleja este concepto es la siguiente: supóngase un juego como el trivial en el que los equipos tienen que acertar preguntas sobre temáticas diversas. Un equipo formado por muchos jugadores, cada uno experto en un tema distinto, tendrá más posibilidades de ganar que un equipo formado por jugadores expertos en un único tema o por un único jugador que sepa un poco de todos los temas.

A continuación, se describe con más detalle la estrategia de bagging, sobre la que se fundamenta el modelo Random Forest.

Bagging¶

El término bagging es el diminutivo de bootstrap aggregation, y hace referencia al empleo del muestreo repetido con reposición bootstrapping) con el fin de reducir la varianza de algunos modelos de aprendizaje estadístico, entre ellos los basados en árboles.

Dadas $n$ muestras de observaciones independientes $Z_1$, ..., $Z_n$, cada una con varianza $\sigma^2$, la varianza de la media de las observaciones $\overline{Z}$ es $\sigma^2/n$. En otras palabras, promediando un conjunto de observaciones se reduce la varianza. Basándose en esta idea, una forma de reducir la varianza y aumentar la precisión de un método predictivo es obtener múltiples muestras de la población, ajustar un modelo distinto con cada una de ellas, y hacer la media (la moda en el caso de variables cualitativas) de las predicciones resultantes. Como en la práctica no se suele tener acceso a múltiples muestras, se puede simular el proceso recurriendo a bootstrapping), generando así pseudo-muestras con los que ajustar diferentes modelos y después agregarlos. A este proceso se le conoce como bagging y es aplicable a una gran variedad de métodos de regresión.

En el caso particular de los árboles de decisión, dada su naturaleza de bajo bias y alta varianza, bagging ha demostrado tener muy buenos resultados. La forma de aplicarlo es:

Generar $B$ pseudo-training sets mediante bootstrapping a partir de la muestra de entrenamiento original.

Entrenar un árbol con cada una de las $B$ muestras del paso 1. Cada árbol se crea sin apenas restricciones y no se somete a pruning, por lo que tiene varianza alta pero poco bias. En la mayoría de casos, la única regla de parada es el número mínimo de observaciones que deben tener los nodos terminales. El valor óptimo de este hiperparámetro puede obtenerse comparando el out of bag error o por validación cruzada.

Para cada nueva observación, obtener la predicción de cada uno de los $B$ árboles. El valor final de la predicción se obtiene como la media de las $B$ predicciones en el caso de variables cuantitativas y como la clase predicha más frecuente (moda) para variables cualitativas.

En el proceso de bagging, el número de árboles creados no es un hiperparámetro crítico en cuanto a que, por mucho que se incremente el número, no se aumenta el riesgo de overfitting. Alcanzado un determinado número de árboles, la reducción de test error se estabiliza. A pesar de ello, cada árbol ocupa memoria, por lo que no conviene almacenar más de los necesarios.

Entrenamiento de Random Forest¶

El algoritmo de Random Forest es una modificación del proceso de bagging que consigue mejorar los resultados gracias a que decorrelaciona aún más los árboles generados en el proceso.

Recordando el apartado anterior, los beneficios de bagging se basan en el hecho de que, promediando un conjunto de modelos, se consigue reducir la varianza. Esto es cierto siempre y cuando los modelos agregados no estén correlacionados. Si la correlación es alta, la reducción de varianza que se puede lograr es pequeña.

Supóngase un set de datos en el que hay un predictor muy influyente, junto con otros moderadamente influyentes. En este escenario, todos o casi todos los árboles creados en el proceso de bagging estarán dominados por el mismo predictor y serán muy parecidos entre ellos. Como consecuencia de la alta correlación entre los árboles, el proceso de bagging apenas conseguirá disminuir la varianza y, por lo tanto, tampoco mejorar el modelo. Random forest evita este problema haciendo una selección aleatoria de $m$ predictores antes de evaluar cada división. De esta forma, un promedio de $(p-m)/p$ divisiones no contemplarán el predictor influyente, permitiendo que otros predictores puedan ser seleccionados. Añadiendo este paso extra se consigue decorrelacionar los árboles todavía más, con lo que su agregación consigue una mayor reducción de la varianza.

Los métodos de random forest y bagging siguen el mismo algoritmo con la única diferencia de que, en random forest, antes de cada división, se seleccionan aleatoriamente $m$ predictores. La diferencia en el resultado dependerá del valor $m$ escogido. Si $m=p$ los resultados de random forest y bagging son equivalentes. Algunas recomendaciones son:

La raíz cuadrada del número total de predictores para problemas de clasificación. $m \approx \sqrt{p}$

Un tercio del número de predictores para problemas de regresión. $m \approx \frac{p}{3}$

Si los predictores están muy correlacionados, valores pequeños de $m$ consiguen mejores resultados.

Sin embargo, la mejor forma para encontrar el valor óptimo de $m$ es evaluar el out-of-bag-error o recurrir a validación cruzada.

Al igual que ocurre con bagging, random forest no sufre problemas de overfit por aumentar el número de árboles creados en el proceso. Alcanzado un determinado número, la reducción del error de test se estabiliza.

Predicción de Random Forest¶

La predicción de un modelo Random Forest es la media de las predicciones de todos los árboles que lo forman.

Supóngase que se dispone de 10 observaciones, cada una con un valor de variable respuesta $Y$ y unos predictores $X$.

| id | 1 | 2 | 3 | 4 | 5 | 6 | 7 | 8 | 9 | 10 |

| Y | 10 | 18 | 24 | 8 | 2 | 9 | 16 | 10 | 20 | 14 |

| X | ... | ... | ... | ... | ... | ... | ... | ... | ... | ... |

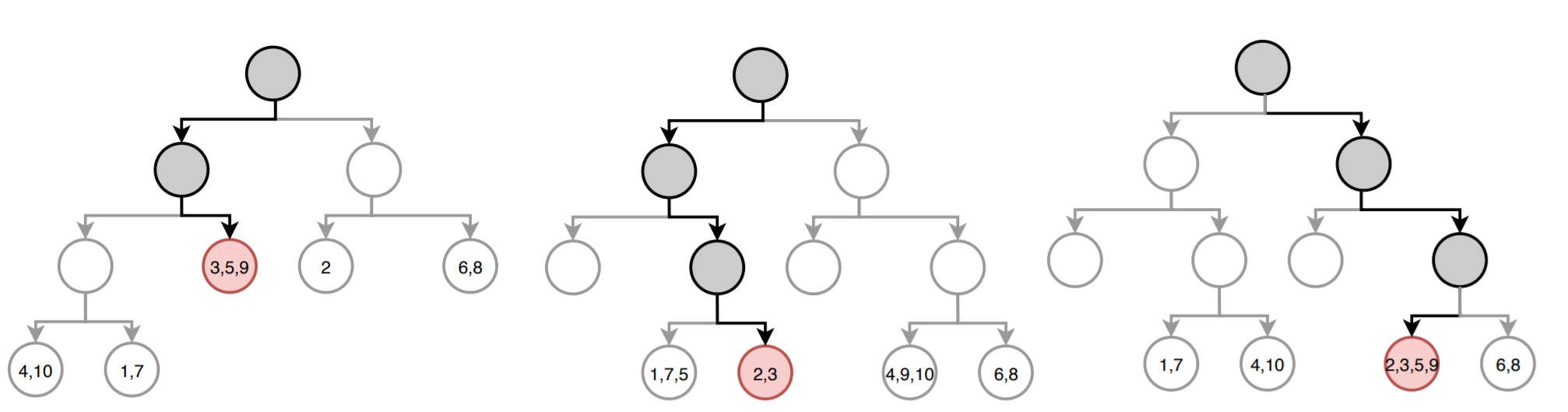

La siguiente imagen muestra cómo sería la predicción del modelo para una nueva observación. En cada árbol, el camino hasta llegar al nodo final está resaltado. En cada nodo terminal se detalla el índice de las observaciones de entrenamiento que forman parte.

El valor predicho por cada árbol es la media de la variable respuesta $Y$ en el nodo terminal. Acorde a la imagen, las predicciones de cada uno de los tres árboles (de izquierda a derecha) es:

$$\hat{y}_{arbol_1} = \frac{24 + 2 + 20}{3} = 15.33333$$$$\hat{y}_{arbol_2} = \frac{18 + 24}{2} = 21$$$$\hat{y}_{arbol_3} = \frac{18 + 24 + 2 + 20}{4} = 16$$La predicción final del modelo es la media de todas las predicciones individuales:

$$\hat{\mu} = \frac{15.33333+21+16}{3} = 17.4$$Aunque la anterior es la forma más común de obtener las predicciones de un modelo Random Forest, existe otra aproximación. La predicción de un árbol de regresión puede verse como una variante de vecinos cercanos en la que, solo las observaciones que forman parte del mismo nodo terminal que la observación predicha, tienen influencia. Siguiendo esta aproximación, la predicción del árbol se define como la media ponderada de todas las observaciones de entrenamiento, donde el peso de cada observación depende únicamente de si forma parte o no del mismo nodo terminal. Para Random Forest esto equivale a la media ponderada de todas las observaciones, empleando como pesos $\textbf{w}$ la media de los vectores de pesos de todos los árboles.

Acorde a la imagen anterior, el vector de pesos para cada uno de los tres árboles (de izquierda a derecha) es:

$$\textbf{w}_{arbol_1} = (0, 0, \frac{1}{3}, 0, \frac{1}{3}, 0, 0, 0, \frac{1}{3}, 0)$$$$\textbf{w}_{arbol_2} = (0, \frac{1}{2}, \frac{1}{2}, 0, 0, 0, 0, 0, 0, 0)$$$$\textbf{w}_{arbol_3} = (0, \frac{1}{4}, \frac{1}{4}, 0, \frac{1}{4}, 0, 0, 0, \frac{1}{4}, 0)$$La media de todos los vectores de pesos es:

$$\overline{\textbf{w}} = \frac{1}{3}(\textbf{w}_{arbol_1} + \textbf{w}_{arbol_2} + \textbf{w}_{arbol_3}) = \\ (0, \frac{1}{4}, \frac{13}{36}, 0, \frac{7}{36}, 0, 0, 0, \frac{7}{36}, 0)$$Una vez obtenido el vector de pesos promedio, se puede calcular la predicción con la media ponderada de todas las observaciones de entrenamiento:

$$\hat{\mu} = \sum^n_{i =1} \overline{\textbf{w}}_i Y_i$$$$\hat{\mu} = (0\times10) + (\frac{1}{4}\times18) + (\frac{13}{36}\times24) + (0\times8) + (\frac{1}{4}\times2) + \\ (0\times9) + (0\times16) + (0\times10) + (\frac{1}{4}\times20) + (0\times14) = 17.4$$Out-of-Bag Error¶

Dada la naturaleza del proceso de bagging, resulta posible estimar el error de test sin necesidad de recurrir a métodos de validación cruzada (cross-validation). El hecho de que los árboles se ajusten empleando muestras generadas por bootstrapping conlleva que, en promedio, cada ajuste use solo aproximadamente dos tercios de las observaciones originales. Al tercio restante se le llama out-of-bag (OOB).

Si para cada árbol ajustado en el proceso de bagging se registran las observaciones empleadas, se puede predecir la respuesta de la observación $i$ haciendo uso de aquellos árboles en los que esa observación ha sido excluida y promediándolos (la moda en el caso de los árboles de clasificación). Siguiendo este proceso, se pueden obtener las predicciones para las $n$ observaciones y con ellas calcular el OOB-mean square error (para regresión) o el OOB-classification error (para árboles de clasificación). Como la variable respuesta de cada observación se predice empleando únicamente los árboles en cuyo ajuste no participó dicha observación, el OOB-error sirve como estimación del error de test. De hecho, si el número de árboles es suficientemente alto, el OOB-error es prácticamente equivalente al leave-one-out cross-validation error.

Esta es una ventaja añadida de los métodos de bagging, y por lo tanto de Random Forest ya que evita tener que recurrir al proceso de validación cruzada (computacionalmente costoso) para la optimización de los hiperparámetros.

Dos limitaciones en el uso Out-of-Bag Error:

El Out-of-Bag Error no es adecuado cuando las observaciones tienen una relación temporal (series temporales). Como la selección de las observaciones que participan en cada entrenamiento es aleatoria, no respetan el orden temporal y se estaría introduciendo información a futuro.

El preprocesado de los datos de entrenamiento se hace de forma conjunta, por lo que las observaciones out-of-bag pueden sufrir data leakage). De ser así, las estimaciones del OOB-error son demasiado optimistas.

En un muestreo por bootstrapping, si el tamaño de los datos de entrenamiento es $n$, cada observación tiene una probabilidad de ser elegida de $\frac{1}{n}$. Por lo tanto, la probabilidad de no ser elegida en todo el proceso es de $(1-1/n)n$, lo que converge en $1/\epsilon$, que es aproximadamente un tercio.

Importancia de los predictores¶

Si bien es cierto que el proceso de bagging (Random Forest) consigue mejorar la capacidad predictiva en comparación a los modelos basados en un único árbol, esto tiene un coste asociado, la interpretabilidad del modelo se reduce. Al tratarse de una combinación de múltiples árboles, no es posible obtener una representación gráfica sencilla del modelo y no es inmediato identificar de forma visual que predictores son más importantes. Sin embargo, se han desarrollado nuevas estrategias para cuantificar la importancia de los predictores que hacen de los modelos de bagging (Random Forest) una herramienta muy potente, no solo para predecir, sino también para el análisis exploratorio. Dos de estas medidas son: importancia por permutación e impureza de nodos.

Importancia por permutación

Identifica la influencia que tiene cada predictor sobre una determinada métrica de evaluación del modelo (estimada por out-of-bag error o validación cruzada). El valor asociado con cada predictor se obtiene de la siguiente forma:

Crear el conjunto de árboles que forman el modelo.

Calcular una determinada métrica de error (mse, classification error, ...). Este es el valor de referencia ($error_0$).

Para cada predictor $j$:

Permutar en todos los árboles del modelo los valores del predictor $j$ manteniendo el resto constante.

Recalcular la métrica tras la permutación, llámese ($error_j$).

Calcular el incremento en la métrica debido a la permutación del predictor $j$.

Si el predictor permutado estaba contribuyendo al modelo, es de esperar que el modelo aumente su error, ya que se pierde la información que proporcionaba esa variable. El porcentaje en que se incrementa el error debido a la permutación del predictor $j$ puede interpretarse como la influencia que tiene $j$ sobre el modelo. Algo que suele llevar a confusiones es el hecho de que este incremento puede resultar negativo. Si la variable no contribuye al modelo, es posible que, al reorganizarla aleatoriamente, solo por azar, se consiga mejorar ligeramente el modelo, por lo que $(error_j - error_0)$ es negativo. A modo general, se puede considerar que estas variables tiene una importancia próxima a cero.

Aunque esta estrategia suele ser la más recomendado, cabe tomar algunas precauciones en su interpretación. Lo que cuantifican es la influencia que tienen los predictores sobre el modelo, no su relación con la variable respuesta. ¿Por qué es esto tan importante? Supóngase un escenario en el que se emplea esta estrategia con la finalidad de identificar qué predictores están relacionados con el peso de una persona, y que dos de los predictores son: el índice de masa corporal (IMC) y la altura. Como IMC y altura están muy correlacionados entre sí (la información que aportan es redundante), cuando se permute uno de ellos, el impacto en el modelo será mínimo, ya que el otro aporta la misma información. Como resultado, estos predictores aparecerán como poco influyentes aun cuando realmente están muy relacionados con la variable respuesta. Una forma de evitar problemas de este tipo es, siempre que se excluyan predictores de un modelo, comprobar el impacto que tiene en su capacidad predictiva.

Incremento de la pureza de nodos

Cuantifica el incremento total en la pureza de los nodos debido a divisiones en las que participa el predictor (promedio de todos los árboles). La forma de calcularlo es la siguiente: en cada división de los árboles, se registra el descenso conseguido en la medida empleada como criterio de división (índice Gini, mse entropía, ...). Para cada uno de los predictores, se calcula el descenso medio conseguido en el conjunto de árboles que forman el ensemble. Cuanto mayor sea este valor medio, mayor la contribución del predictor en el modelo.

Ejemplo regresión¶

El set de datos Boston contiene precios de viviendas de la ciudad de Boston, así como información socio-económica del barrio en el que se encuentran. Se pretende ajustar un modelo de regresión que permita predecir el precio medio de una vivienda (MEDV) en función de las variables disponibles.

Librerías¶

Las librerías utilizadas en este ejemplo son:

# Tratamiento de datos

# ==============================================================================

import numpy as np

import pandas as pd

# Gráficos

# ==============================================================================

import matplotlib.pyplot as plt

plt.style.use('fivethirtyeight')

plt.rcParams['lines.linewidth'] = 1.5

plt.rcParams['font.size'] = 8

# Preprocesado y modelado

# ==============================================================================

import sklearn

from sklearn.ensemble import RandomForestRegressor

from sklearn.metrics import root_mean_squared_error

from sklearn.model_selection import cross_val_score

from sklearn.model_selection import train_test_split

from sklearn.model_selection import RepeatedKFold

from sklearn.model_selection import GridSearchCV

from sklearn.model_selection import ParameterGrid

from sklearn.model_selection import cross_val_score

from sklearn.inspection import permutation_importance

from joblib import Parallel, delayed, cpu_count

import optuna

# Configuración warnings

# ==============================================================================

import warnings

optuna.logging.set_verbosity(optuna.logging.WARNING)

print(f"Versión de scikit-learn: {sklearn.__version__}")

Versión de scikit-learn: 1.7.1

Datos¶

El set de datos Boston contiene precios de viviendas de la ciudad de Boston, así como información socio-económica del barrio en el que se encuentran. Se pretende ajustar un modelo de regresión que permita predecir el precio medio de una vivienda (MEDV) en función de las variables disponibles.

Número de instancias: 506

Número de atributos: 13 predictivos numéricos/categoriales.

Información de los atributos (por orden):

- CRIM: tasa de delincuencia per cápita por ciudad.

- ZN: proporción de suelo residencial dividido para segmentos de más de 25.000 pies cuadrados.

- INDUS: proporción de superficie comerciales no minoristas por ciudad.

- CHAS: variable binaria sobre el río Charles (= 1 si la zona linda con el río; 0 en caso contrario).

- NOX: concentración de óxidos nítricos (partes por 10 millones).

- RM: número medio de habitaciones por vivienda.

- EDAD: proporción de viviendas ocupadas construidas antes de 1940.

- DIS: distancia ponderada a cinco centros de empleo en la ciudad de Boston.

- RAD: índice de accesibilidad a las autopistas radiales.

- TAX: impuesto sobre bienes inmuebles de valor íntegro por cada 10.000$.

- PTRATIO: ratio alumnos-profesor por ciudad.

- LSTAT: % de la población considerado de clase baja.

- MEDV: valor medio de las viviendas ocupadas por sus propietarios en miles de $.

Valores ausentes: Ninguno

# Descarga de datos

# ==============================================================================

url = (

'https://raw.githubusercontent.com/JoaquinAmatRodrigo/Estadistica-machine-learning-python/'

'master/data/Boston.csv'

)

datos = pd.read_csv(url, sep=',')

display(datos.head(3))

display(datos.info())

| CRIM | ZN | INDUS | CHAS | NOX | RM | AGE | DIS | RAD | TAX | PTRATIO | LSTAT | MEDV | |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| 0 | 0.00632 | 18.0 | 2.31 | 0 | 0.538 | 6.575 | 65.2 | 4.0900 | 1 | 296 | 15.3 | 4.98 | 24.0 |

| 1 | 0.02731 | 0.0 | 7.07 | 0 | 0.469 | 6.421 | 78.9 | 4.9671 | 2 | 242 | 17.8 | 9.14 | 21.6 |

| 2 | 0.02729 | 0.0 | 7.07 | 0 | 0.469 | 7.185 | 61.1 | 4.9671 | 2 | 242 | 17.8 | 4.03 | 34.7 |

<class 'pandas.core.frame.DataFrame'> RangeIndex: 506 entries, 0 to 505 Data columns (total 13 columns): # Column Non-Null Count Dtype --- ------ -------------- ----- 0 CRIM 506 non-null float64 1 ZN 506 non-null float64 2 INDUS 506 non-null float64 3 CHAS 506 non-null int64 4 NOX 506 non-null float64 5 RM 506 non-null float64 6 AGE 506 non-null float64 7 DIS 506 non-null float64 8 RAD 506 non-null int64 9 TAX 506 non-null int64 10 PTRATIO 506 non-null float64 11 LSTAT 506 non-null float64 12 MEDV 506 non-null float64 dtypes: float64(10), int64(3) memory usage: 51.5 KB

None

Ajuste del modelo¶

Se ajusta un modelo empleando como variable respuesta MEDV y como predictores todas las otras variables disponibles.

La clase RandomForestRegressor del módulo sklearn.ensemble permite entrenar modelos random forest para problemas de regresión. Los parámetros e hiperparámetros empleados por defecto son:

n_estimators=100criterion='squared_error'max_depth=Nonemin_samples_split=2min_samples_leaf=1min_weight_fraction_leaf=0.0max_features=1.0max_leaf_nodes=Nonemin_impurity_decrease=0.0bootstrap=Trueoob_score=Falsen_jobs=Nonerandom_state=Noneverbose=0warm_start=Falseccp_alpha=0.0max_samples=None

De entre todos ellos, destacan aquellos que detienen el crecimiento de los árboles, los que controlan el número de árboles y predictores incluidos, y los que gestionan la paralelización:

n_estimators; número de árboles incluidos en el modelo.max_depth: profundidad máxima que pueden alcanzar los árboles.min_samples_split: número mínimo de observaciones que debe de tener un nodo para que pueda dividirse. Si es un valor decimal se interpreta como fracción del total de observaciones de entrenamientoceil(min_samples_split * n_samples).min_samples_leaf: número mínimo de observaciones que debe de tener cada uno de los nodos hijos para que se produzca la división. Si es un valor decimal se interpreta como fracción del total de observaciones de entrenamientoceil(min_samples_split * n_samples).max_leaf_nodes: número máximo de nodos terminales que pueden tener los árboles.max_features: número de predictores considerados a en cada división. Puede ser:- Un valor entero

- Una fracción del total de predictores..

- “sqrt”, raiz cuadrada del número total de predictores.

- “log2”, log2 del número total de predictores.

- None, utiliza todos los predictores.

oob_score: Si se calcula o no el out-of-bag R^2. Por defecto esFalseya que aumenta el tiempo de entrenamiento.n_jobs: número de cores empleados para el entrenamiento. En random forest los árboles se ajustan de forma independiente, por lo la paralelización reduce notablemente el tiempo de entrenamiento. Con-1se utilizan todos los cores disponibles.random_state: semilla para que los resultados sean reproducibles. Tiene que ser un valor entero.

Como en todo estudio predictivo, no solo es importante ajustar el modelo, sino también cuantificar su capacidad para predecir nuevas observaciones. Para poder hacer esta evaluación, se dividen los datos en dos grupos, uno de entrenamiento y otro de test.

# División de los datos en entrenamiento y test

# ==============================================================================

X_train, X_test, y_train, y_test = train_test_split(

datos.drop(columns="MEDV"),

datos['MEDV'],

test_size = 0.25,

random_state = 123

)

print(f"Tamaño conjunto entrenamiento: {X_train.shape[0]}")

print(f"Tamaño conjunto test: {X_test.shape[0]}")

# Creación del modelo

# ==============================================================================

modelo = RandomForestRegressor(

n_estimators = 10,

criterion = 'squared_error',

max_depth = None,

max_features = 1,

oob_score = False,

n_jobs = -1,

random_state = 123

)

# Entrenamiento del modelo

# ==============================================================================

modelo.fit(X_train, y_train)

Tamaño conjunto entrenamiento: 379 Tamaño conjunto test: 127

RandomForestRegressor(max_features=1, n_estimators=10, n_jobs=-1,

random_state=123)In a Jupyter environment, please rerun this cell to show the HTML representation or trust the notebook. On GitHub, the HTML representation is unable to render, please try loading this page with nbviewer.org.

Parameters

| n_estimators | 10 | |

| criterion | 'squared_error' | |

| max_depth | None | |

| min_samples_split | 2 | |

| min_samples_leaf | 1 | |

| min_weight_fraction_leaf | 0.0 | |

| max_features | 1 | |

| max_leaf_nodes | None | |

| min_impurity_decrease | 0.0 | |

| bootstrap | True | |

| oob_score | False | |

| n_jobs | -1 | |

| random_state | 123 | |

| verbose | 0 | |

| warm_start | False | |

| ccp_alpha | 0.0 | |

| max_samples | None | |

| monotonic_cst | None |

Predicción y evaluación del modelo¶

Una vez entrenado el modelo, se evalúa la capacidad predictiva empleando el conjunto de test.

# Error de test del modelo inicial

# ==============================================================================

predicciones = modelo.predict(X=X_test)

rmse = root_mean_squared_error(y_true=y_test, y_pred=predicciones)

print(f"El error (rmse) de test es: {rmse}")

El error (rmse) de test es: 4.17800427058654

Optimización de hiperparámetros¶

El modelo inicial se ha entrenado utilizando 10 árboles (n_estimators=10) y manteniendo el resto de hiperparámetros con su valor por defecto. Al ser hiperparámetros, no se puede saber de antemano cuál es el valor más adecuado, la forma de identificarlos es mediante el uso de estrategias de validación, por ejemplo validación cruzada.

Los modelos Random Forest tienen la ventaja de disponer del Out-of-Bag error, lo que permite obtener una estimación del error de test sin recurrir a la validación cruzada, que es computacionalmente costosa. En la implementación de RandomForestRegressor, la métrica devuelta como oob_score es el $R^2$, si se desea otra, se tiene que recurrir al método oob_decision_function_() para obtener las predicciones y con ellas calcular la métrica de interés. Para una explicación más detallada consultar: Grid search de modelos Random Forest con out-of-bag error y early stopping.

Cabe tener en cuenta que, cuando se busca el valor óptimo de un hiperparámetro con dos métricas distintas, el resultado obtenido raramente es el mismo. Lo importante es que ambas métricas identifiquen las mismas regiones de interés.

Número de árboles¶

En Random Forest, el número de árboles no es un hiperparámetro crítico en cuanto que, añadir árboles, solo puede hacer que mejorar el resultado. En Random Forest no se produce overfitting por exceso de árboles. Sin embargo, añadir árboles una vez que la mejora se estabiliza es una perdida te recursos computacionales.

# Validación empleando el Out-of-Bag error

# ==============================================================================

warnings.filterwarnings('ignore')

train_scores = []

oob_scores = []

# Valores evaluados

estimator_range = range(1, 150, 5)

# Bucle para entrenar un modelo con cada valor de n_estimators y extraer su error

# de entrenamiento y de Out-of-Bag.

for n_estimators in estimator_range:

modelo = RandomForestRegressor(

n_estimators = n_estimators,

criterion = 'squared_error',

max_depth = None,

max_features = 1,

oob_score = True,

n_jobs = -1,

random_state = 123

)

modelo.fit(X_train, y_train)

train_scores.append(modelo.score(X_train, y_train))

oob_scores.append(modelo.oob_score_)

# Gráfico con la evolución de los errores

fig, ax = plt.subplots(figsize=(5, 3))

ax.plot(estimator_range, train_scores, label="train scores")

ax.plot(estimator_range, oob_scores, label="out-of-bag scores")

ax.plot(estimator_range[np.argmax(oob_scores)], max(oob_scores),

marker='o', color = "red", label="max score")

ax.set_ylabel("R^2")

ax.set_xlabel("n_estimators")

ax.set_title("Evolución del out-of-bag-error vs número árboles")

plt.legend();

print(f"Valor óptimo de n_estimators: {estimator_range[np.argmax(oob_scores)]}")

warnings.filterwarnings('default')

Valor óptimo de n_estimators: 66

# Validación empleando k-cross-validation y neg_root_mean_squared_error

# ==============================================================================

train_scores = []

cv_scores = []

# Valores evaluados

estimator_range = range(1, 150, 5)

# Bucle para entrenar un modelo con cada valor de n_estimators y extraer su error

# de entrenamiento y de k-cross-validation.

for n_estimators in estimator_range:

modelo = RandomForestRegressor(

n_estimators = n_estimators,

criterion = 'squared_error',

max_depth = None,

max_features = 1,

oob_score = False,

n_jobs = -1,

random_state = 123

)

# Error de entrenamiento

modelo.fit(X_train, y_train)

predicciones = modelo.predict(X=X_train)

rmse = root_mean_squared_error(

y_true = y_train,

y_pred = predicciones,

)

train_scores.append(rmse)

# Error de validación cruzada

scores = cross_val_score(

estimator = modelo,

X = X_train,

y = y_train,

scoring = 'neg_root_mean_squared_error',

cv = 5

)

# Se agregan los scores de cross_val_score() y se pasa a positivo

cv_scores.append(-1*scores.mean())

# Gráfico con la evolución de los errores

fig, ax = plt.subplots(figsize=(5, 3))

ax.plot(estimator_range, train_scores, label="train scores")

ax.plot(estimator_range, cv_scores, label="cv scores")

ax.plot(estimator_range[np.argmin(cv_scores)], min(cv_scores),

marker='o', color = "red", label="min score")

ax.set_ylabel("root_mean_squared_error")

ax.set_xlabel("n_estimators")

ax.set_title("Evolución del cv-error vs número árboles")

plt.legend();

print(f"Valor óptimo de n_estimators: {estimator_range[np.argmin(cv_scores)]}")

Valor óptimo de n_estimators: 96

Si bien el valor óptimo de las métricas se alcanza con 66 y 96 árboles, las curvas indican que, a partir de 20 árboles, el error de validación del modelo se estabiliza.

Max features¶

El valor de máx_features es uno de los hiperparámetros más importantes de random forest, ya que es el que permite controlar cuánto se decorrelacionan los árboles entre sí.

# Validación empleando el Out-of-Bag error

# ==============================================================================

train_scores = []

oob_scores = []

# Valores evaluados

max_features_range = range(1, X_train.shape[1] + 1, 1)

# Bucle para entrenar un modelo con cada valor de max_features y extraer su error

# de entrenamiento y de Out-of-Bag.

for max_features in max_features_range:

modelo = RandomForestRegressor(

n_estimators = 100,

criterion = 'squared_error',

max_depth = None,

max_features = max_features,

oob_score = True,

n_jobs = -1,

random_state = 123

)

modelo.fit(X_train, y_train)

train_scores.append(modelo.score(X_train, y_train))

oob_scores.append(modelo.oob_score_)

# Gráfico con la evolución de los errores

fig, ax = plt.subplots(figsize=(5, 3))

ax.plot(max_features_range, train_scores, label="train scores")

ax.plot(max_features_range, oob_scores, label="out-of-bag scores")

ax.plot(max_features_range[np.argmax(oob_scores)], max(oob_scores),

marker='o', color = "red")

ax.set_ylabel("R^2")

ax.set_xlabel("max_features")

ax.set_title("Evolución del out-of-bag-error vs número de predictores")

plt.legend();

print(f"Valor óptimo de max_features: {max_features_range[np.argmax(oob_scores)]}")

Valor óptimo de max_features: 4

# Validación empleando k-cross-validation y neg_root_mean_squared_error

# ==============================================================================

train_scores = []

cv_scores = []

# Valores evaluados

max_features_range = range(1, X_train.shape[1] + 1, 1)

# Bucle para entrenar un modelo con cada valor de max_features y extraer su error

# de entrenamiento y de k-cross-validation.

for max_features in max_features_range:

modelo = RandomForestRegressor(

n_estimators = 100,

criterion = 'squared_error',

max_depth = None,

max_features = max_features,

oob_score = True,

n_jobs = -1,

random_state = 123

)

# Error de train

modelo.fit(X_train, y_train)

predicciones = modelo.predict(X = X_train)

rmse = root_mean_squared_error(

y_true = y_train,

y_pred = predicciones,

)

train_scores.append(rmse)

# Error de validación cruzada

scores = cross_val_score(

estimator = modelo,

X = X_train,

y = y_train,

scoring = 'neg_root_mean_squared_error',

cv = 5

)

# Se agregan los scores de cross_val_score() y se pasa a positivo

cv_scores.append(-1*scores.mean())

# Gráfico con la evolución de los errores

fig, ax = plt.subplots(figsize=(5, 3))

ax.plot(max_features_range, train_scores, label="train scores")

ax.plot(max_features_range, cv_scores, label="cv scores")

ax.plot(max_features_range[np.argmin(cv_scores)], min(cv_scores),

marker='o', color = "red", label="min score")

ax.set_ylabel("root_mean_squared_error")

ax.set_xlabel("max_features")

ax.set_title("Evolución del cv-error vs número de predictores")

plt.legend();

print(f"Valor óptimo de max_features: {max_features_range[np.argmin(cv_scores)]}")

Valor óptimo de max_features: 6

Acorde a las dos métricas utilizadas, el valor óptimo de max_features está entre 4 y 6.

Grid search¶

Aunque el análisis individual de los hiperparámetros es útil para entender su impacto en el modelo e identificar rangos de interés, la búsqueda final no debe hacerse de forma secuencial, ya que cada hiperparámetro interacciona con los demás. Es preferible recurrir a grid search, random search o bayesian search para analizar varias combinaciones de hiperparámetros. Puede encontrarse más información sobre las estrategias de búsqueda en Machine learning con Python y Scikit-learn.

Out-of-bag error¶

Más detalles en: Grid search de modelos Random Forest con out-of-bag error y early stopping.

# Grid de hiperparámetros evaluados

# ==============================================================================

param_grid = ParameterGrid(

{'n_estimators': [150],

'max_features': [5, 7, 9],

'max_depth' : [None, 3, 10, 20]

}

)

# Loop para ajustar un modelo con cada combinación de hiperparámetros

# ==============================================================================

resultados = {'params': [], 'oob_r2': []}

for params in param_grid:

modelo = RandomForestRegressor(

oob_score = True,

n_jobs = -1,

random_state = 123,

** params

)

modelo.fit(X_train, y_train)

resultados['params'].append(params)

resultados['oob_r2'].append(modelo.oob_score_)

print(f"Modelo: {params} ✓")

# Resultados

# ==============================================================================

resultados = pd.DataFrame(resultados)

resultados = pd.concat([resultados, resultados['params'].apply(pd.Series)], axis=1)

resultados = resultados.drop(columns = 'params')

resultados = resultados.sort_values('oob_r2', ascending=False)

resultados.head(4)

Modelo: {'max_depth': None, 'max_features': 5, 'n_estimators': 150} ✓

Modelo: {'max_depth': None, 'max_features': 7, 'n_estimators': 150} ✓

Modelo: {'max_depth': None, 'max_features': 9, 'n_estimators': 150} ✓

Modelo: {'max_depth': 3, 'max_features': 5, 'n_estimators': 150} ✓

Modelo: {'max_depth': 3, 'max_features': 7, 'n_estimators': 150} ✓

Modelo: {'max_depth': 3, 'max_features': 9, 'n_estimators': 150} ✓

Modelo: {'max_depth': 10, 'max_features': 5, 'n_estimators': 150} ✓

Modelo: {'max_depth': 10, 'max_features': 7, 'n_estimators': 150} ✓

Modelo: {'max_depth': 10, 'max_features': 9, 'n_estimators': 150} ✓

Modelo: {'max_depth': 20, 'max_features': 5, 'n_estimators': 150} ✓

Modelo: {'max_depth': 20, 'max_features': 7, 'n_estimators': 150} ✓

Modelo: {'max_depth': 20, 'max_features': 9, 'n_estimators': 150} ✓

| oob_r2 | max_depth | max_features | n_estimators | |

|---|---|---|---|---|

| 6 | 0.882461 | 10.0 | 5.0 | 150.0 |

| 0 | 0.875289 | NaN | 5.0 | 150.0 |

| 9 | 0.874590 | 20.0 | 5.0 | 150.0 |

| 10 | 0.874318 | 20.0 | 7.0 | 150.0 |

Este proceso de búsqueda puede paralelizarse para aprovechar todos cores del ordenador.

# Grid de hiperparámetros evaluados

# ==============================================================================

param_grid = ParameterGrid(

{'n_estimators': [150],

'max_features': [5, 7, 9],

'max_depth' : [None, 3, 10, 20]

}

)

# Loop paralelizado para ajustar un modelo con cada combinación de hiperparámetros

# ==============================================================================

def eval_oob_error(X, y, params, verbose=True):

"""

Función para entrenar un modelo utilizando unos parámetros determinados

y que devuelve el out-of-bag error

"""

modelo = RandomForestRegressor(

oob_score = True,

n_jobs = -1,

random_state = 123,

** params

)

modelo.fit(X, y)

if verbose:

print(f"Modelo: {params} ✓")

return{'params': params, 'oob_r2': modelo.oob_score_}

resultados = Parallel(n_jobs=cpu_count()-1)(

delayed(eval_oob_error)(X_train, y_train, params)

for params in param_grid

)

# Resultados

# ==============================================================================

resultados = pd.DataFrame(resultados)

resultados = pd.concat([resultados, resultados['params'].apply(pd.Series)], axis=1)

resultados = resultados.drop(columns = 'params')

resultados = resultados.sort_values('oob_r2', ascending=False)

resultados.head(4)

Modelo: {'max_depth': None, 'max_features': 5, 'n_estimators': 150} ✓

Modelo: {'max_depth': 3, 'max_features': 5, 'n_estimators': 150} ✓

Modelo: {'max_depth': 3, 'max_features': 9, 'n_estimators': 150} ✓

Modelo: {'max_depth': None, 'max_features': 7, 'n_estimators': 150} ✓

Modelo: {'max_depth': None, 'max_features': 9, 'n_estimators': 150} ✓

Modelo: {'max_depth': 10, 'max_features': 5, 'n_estimators': 150} ✓

Modelo: {'max_depth': 3, 'max_features': 7, 'n_estimators': 150} ✓

Modelo: {'max_depth': 10, 'max_features': 7, 'n_estimators': 150} ✓

Modelo: {'max_depth': 10, 'max_features': 9, 'n_estimators': 150} ✓

Modelo: {'max_depth': 20, 'max_features': 5, 'n_estimators': 150} ✓

Modelo: {'max_depth': 20, 'max_features': 7, 'n_estimators': 150} ✓

Modelo: {'max_depth': 20, 'max_features': 9, 'n_estimators': 150} ✓

| oob_r2 | max_depth | max_features | n_estimators | |

|---|---|---|---|---|

| 6 | 0.882461 | 10.0 | 5.0 | 150.0 |

| 0 | 0.875289 | NaN | 5.0 | 150.0 |

| 9 | 0.874590 | 20.0 | 5.0 | 150.0 |

| 10 | 0.874318 | 20.0 | 7.0 | 150.0 |

# Mejores hiperparámetros por out-of-bag error

# ==============================================================================

print("--------------------------------------------")

print("Mejores hiperparámetros encontrados (oob-r2)")

print("--------------------------------------------")

print(resultados.iloc[0,0:])

-------------------------------------------- Mejores hiperparámetros encontrados (oob-r2) -------------------------------------------- oob_r2 0.882461 max_depth 10.000000 max_features 5.000000 n_estimators 150.000000 Name: 6, dtype: float64

Validación cruzada¶

⚠ Warning

La busqueda de hiperparámetros debe hacerse utilizando datos que el modelo no ha visto. Si se emplean los mismos datos para ajustar el modelo y para evaluarlo, se corre el riesgo de sobreajustar el modelo a los datos de entrenamiento. Para evitar este problema se puede recurrir a dos estrategias:

Dividir el conjunto de datos en tres grupos: entrenamiento, validación y test. El conjunto de entrenamiento se emplea para ajustar el modelo, el de validación para seleccionar el valor óptimo de los hiperparámetros y el de test para evaluar la capacidad predictiva del modelo.

Utilizar validación cruzada con los datos de entrenamiento. En este caso, el conjunto de entrenamiento se divide en k grupos y se ajusta el modelo k veces, cada vez con un grupo distinto como conjunto de validación. La métrica final es el promedio de los valores obtenidos en cada iteración. Esta estrategia es computacionalmente más costosa, ya que requiere entrenar el modelo k veces, pero evita tener que crear una partición adicional de los datos cuando no se dispone de muchos.

# Grid de hiperparámetros evaluados

# ==============================================================================

param_grid = {'n_estimators': [150],

'max_features': [5, 7, 9],

'max_depth' : [None, 3, 10, 20]

}

# Búsqueda por grid search con validación cruzada

# ==============================================================================

grid = GridSearchCV(

estimator = RandomForestRegressor(random_state = 123),

param_grid = param_grid,

scoring = 'neg_root_mean_squared_error',

n_jobs = cpu_count() - 1,

cv = RepeatedKFold(n_splits=5, n_repeats=3, random_state=123),

refit = True,

verbose = 0,

return_train_score = True

)

grid.fit(X=X_train, y=y_train)

# Resultados

# ==============================================================================

resultados = pd.DataFrame(grid.cv_results_)

resultados.filter(regex = '(param.*|mean_t|std_t)') \

.drop(columns = 'params') \

.sort_values('mean_test_score', ascending = False) \

.head(4)

| param_max_depth | param_max_features | param_n_estimators | mean_test_score | std_test_score | mean_train_score | std_train_score | |

|---|---|---|---|---|---|---|---|

| 6 | 10 | 5 | 150 | -3.320295 | 0.701794 | -1.323499 | 0.061678 |

| 7 | 10 | 7 | 150 | -3.333357 | 0.696114 | -1.327214 | 0.066324 |

| 0 | None | 5 | 150 | -3.334407 | 0.715278 | -1.261911 | 0.058096 |

| 9 | 20 | 5 | 150 | -3.336755 | 0.716904 | -1.261439 | 0.057603 |

# Mejores hiperparámetros encontrados mediante validación cruzada

# ==============================================================================

print("----------------------------------------")

print("Mejores hiperparámetros encontrados (cv)")

print("----------------------------------------")

print(grid.best_params_, ":", grid.best_score_, grid.scoring)

----------------------------------------

Mejores hiperparámetros encontrados (cv)

----------------------------------------

{'max_depth': 10, 'max_features': 5, 'n_estimators': 150} : -3.320294830700744 neg_root_mean_squared_error

Una vez identificados los mejores hiperparámetros, se reentrena el modelo indicando los valores óptimos en sus argumentos. Si en el GridSearchCV() se indica refit=True, este reentrenamiento se hace automáticamente y

el modelo resultante se encuentra almacenado en .best_estimator_.

# Error de test del modelo final

# ==============================================================================

modelo_final = grid.best_estimator_

predicciones = modelo_final.predict(X=X_test)

rmse = root_mean_squared_error(

y_true = y_test,

y_pred = predicciones,

)

print(f"El error (rmse) de test es: {rmse}")

El error (rmse) de test es: 3.550875871674505

Tras optimizar los hiperparámetros, se consigue reducir el error rmse del modelo de 4.35 a 3.55. Las predicciones del modelo final se alejan en promedio 3.55 unidades (3550 dólares) del valor real.

Bayesian search¶

La búsqueda grid search y random search pueden generar buenos resultados, sobre todo cuando se reduce el rango de exploración. Sin embargo, ninguna de ellas tiene en cuenta los resultados obtenidos hasta el momento, lo que les impide centrar la búsqueda en las regiones de mayor interés y evitar las innecesarias.

Una alternativa es utilizar métodos de optimización bayesiana para buscar hiperparámetros. En términos generales, la optimización bayesiana de hiperparámetros consiste en crear un modelo probabilístico en el que la función objetivo es la métrica de validación del modelo (RMSE, AUC, precisión...). Con esta estrategia, la búsqueda se redirige en cada iteración a las regiones de mayor interés. El objetivo final es reducir el número de combinaciones de hiperparámetros con las que se evalúa el modelo, eligiendo sólo los mejores candidatos. Este enfoque es especialmente ventajoso cuando el espacio de búsqueda es muy grande o la evaluación del modelo es muy lenta.

# Búsqueda bayesiana de hiperparámetros con optuna

# ==============================================================================

def objective(trial):

params = {

'n_estimators': trial.suggest_int('n_estimators', 100, 1000, step=100),

'max_depth': trial.suggest_int('max_depth', 3, 30),

'min_samples_split': trial.suggest_int('min_samples_split', 2, 100),

'min_samples_leaf': trial.suggest_int('min_samples_leaf', 1, 100),

'max_features': trial.suggest_float('max_features', 0.2, 1.0),

'ccp_alpha': trial.suggest_float('ccp_alpha', 0.0, 1),

# Fixed parameters

'n_jobs': -1,

'random_state': 4576688,

}

modelo = RandomForestRegressor(**params)

cross_val_scores = cross_val_score(

estimator = modelo,

X = X_train,

y = y_train,

cv = RepeatedKFold(n_splits=5, n_repeats=3, random_state=123),

scoring = 'neg_root_mean_squared_error',

n_jobs=-1

)

score = np.mean(cross_val_scores)

return score

study = optuna.create_study(direction='maximize') # Se maximiza por que el score es negativo

study.optimize(objective, n_trials=30, show_progress_bar=True, timeout=60*5)

print('Mejores hyperparameters:', study.best_params)

print('Mejor score:', study.best_value)

0%| | 0/30 [00:00<?, ?it/s]

Mejores hyperparameters: {'n_estimators': 200, 'max_depth': 19, 'min_samples_split': 23, 'min_samples_leaf': 10, 'max_features': 0.5010767895372719, 'ccp_alpha': 0.592918283831454}

Mejor score: -4.077406292401763

# Error de test del modelo final

# ==============================================================================

modelo_final = RandomForestRegressor(**study.best_params)

modelo_final.fit(X_train, y_train)

predicciones = modelo_final.predict(X=X_test)

rmse = root_mean_squared_error(y_true=y_test, y_pred=predicciones)

print(f"El error (rmse) de test es: {rmse}")

El error (rmse) de test es: 4.458933398642248

Importancia de predictores¶

Pureza de nodos¶

# Importancia de los predictores basada en la reducción de la impureza

# ==============================================================================

importancia_predictores = pd.DataFrame({

'predictor': datos.drop(columns = "MEDV").columns,

'importancia': modelo_final.feature_importances_

})

print("Importancia de los predictores en el modelo")

print("-------------------------------------------")

importancia_predictores.sort_values('importancia', ascending=False)

Importancia de los predictores en el modelo -------------------------------------------

| predictor | importancia | |

|---|---|---|

| 5 | RM | 0.399866 |

| 11 | LSTAT | 0.378344 |

| 4 | NOX | 0.061980 |

| 10 | PTRATIO | 0.038606 |

| 0 | CRIM | 0.037579 |

| 2 | INDUS | 0.036500 |

| 7 | DIS | 0.026432 |

| 9 | TAX | 0.011672 |

| 6 | AGE | 0.006530 |

| 1 | ZN | 0.001505 |

| 8 | RAD | 0.000986 |

| 3 | CHAS | 0.000000 |

Permutación¶

# Importancia de los predictores basada en permutación

# ==============================================================================

importancia = permutation_importance(

estimator = modelo_final,

X = X_train,

y = y_train,

n_repeats = 5,

scoring = 'neg_root_mean_squared_error',

n_jobs = cpu_count() - 1,

random_state = 123

)

# Se almacenan los resultados (media y desviación) en un dataframe

df_importancia = pd.DataFrame(

{k: importancia[k] for k in ['importances_mean', 'importances_std']}

)

df_importancia['feature'] = X_train.columns

df_importancia.sort_values('importances_mean', ascending=False)

| importances_mean | importances_std | feature | |

|---|---|---|---|

| 11 | 3.463219 | 0.156903 | LSTAT |

| 5 | 3.195968 | 0.077292 | RM |

| 4 | 0.391688 | 0.049401 | NOX |

| 0 | 0.240019 | 0.030626 | CRIM |

| 10 | 0.228540 | 0.028866 | PTRATIO |

| 7 | 0.160030 | 0.021386 | DIS |

| 2 | 0.110869 | 0.013235 | INDUS |

| 9 | 0.068014 | 0.006425 | TAX |

| 6 | 0.040218 | 0.005447 | AGE |

| 8 | 0.015989 | 0.002731 | RAD |

| 1 | 0.004424 | 0.001648 | ZN |

| 3 | 0.000000 | 0.000000 | CHAS |

# Gráfico de la importancia de cada predictor

# ==============================================================================

fig, ax = plt.subplots(figsize=(3.5, 4))

df_importancia = df_importancia.sort_values('importances_mean', ascending=True)

ax.barh(

df_importancia['feature'],

df_importancia['importances_mean'],

xerr=df_importancia['importances_std'],

align='center',

alpha=0

)

ax.plot(

df_importancia['importances_mean'],

df_importancia['feature'],

marker="D",

linestyle="",

alpha=0.8,

color="r"

)

ax.set_title('Importancia de los predictores (train)')

ax.set_xlabel('Incremento del error tras la permutación');

Ambas estrategias identifican LSTAT y RM como los predictores más influyentes, acorde a los datos de entrenamiento.

Ejemplo clasificación¶

Librerías¶

Las librerías utilizadas en este documento son:

# Tratamiento de datos

# ==============================================================================

import numpy as np

import pandas as pd

import statsmodels.api as sm

# Gráficos

# ==============================================================================

import matplotlib.pyplot as plt

plt.style.use('fivethirtyeight')

plt.rcParams['lines.linewidth'] = 1.5

plt.rcParams['font.size'] = 8

# Preprocesado y modelado

# ==============================================================================

from sklearn.ensemble import RandomForestClassifier

from sklearn.metrics import accuracy_score

from sklearn.metrics import confusion_matrix

from sklearn.metrics import ConfusionMatrixDisplay

from sklearn.metrics import classification_report

from sklearn.compose import ColumnTransformer

from sklearn.preprocessing import OneHotEncoder

from sklearn.model_selection import cross_val_score

from sklearn.model_selection import train_test_split

from sklearn.model_selection import RepeatedKFold

from sklearn.model_selection import GridSearchCV

from sklearn.model_selection import ParameterGrid

from sklearn.inspection import permutation_importance

from joblib import Parallel, delayed

import optuna

# Configuración warnings

# ==============================================================================

import warnings

Datos¶

El set de datos Carseats, original del paquete de R ISLR y accesible en Python a través de statsmodels.datasets.get_rdataset, contiene información sobre la venta de sillas infantiles en 400 tiendas distintas. Para cada una de las 400 tiendas se han registrado 11 variables. Se pretende generar un modelo de clasificación que permita predecir si una tienda tiene ventas altas (Sales > 8) o bajas (Sales <= 8) en función de todas las variables disponibles.

✎ Nota

Listado de todos los set de datos disponibles en Rdatasets.# Lectura de datos

# ==============================================================================

carseats = sm.datasets.get_rdataset("Carseats", "ISLR")

datos = carseats.data

print(carseats.__doc__)

.. container::

.. container::

======== ===============

Carseats R Documentation

======== ===============

.. rubric:: Sales of Child Car Seats

:name: sales-of-child-car-seats

.. rubric:: Description

:name: description

A simulated data set containing sales of child car seats at 400

different stores.

.. rubric:: Usage

:name: usage

.. code:: R

Carseats

.. rubric:: Format

:name: format

A data frame with 400 observations on the following 11 variables.

``Sales``

Unit sales (in thousands) at each location

``CompPrice``

Price charged by competitor at each location

``Income``

Community income level (in thousands of dollars)

``Advertising``

Local advertising budget for company at each location (in

thousands of dollars)

``Population``

Population size in region (in thousands)

``Price``

Price company charges for car seats at each site

``ShelveLoc``

A factor with levels ``Bad``, ``Good`` and ``Medium``

indicating the quality of the shelving location for the car

seats at each site

``Age``

Average age of the local population

``Education``

Education level at each location

``Urban``

A factor with levels ``No`` and ``Yes`` to indicate whether the

store is in an urban or rural location

``US``

A factor with levels ``No`` and ``Yes`` to indicate whether the

store is in the US or not

.. rubric:: Source

:name: source

Simulated data

.. rubric:: References

:name: references

James, G., Witten, D., Hastie, T., and Tibshirani, R. (2013) *An

Introduction to Statistical Learning with applications in R*,

https://www.statlearning.com, Springer-Verlag, New York

.. rubric:: Examples

:name: examples

.. code:: R

summary(Carseats)

lm.fit=lm(Sales~Advertising+Price,data=Carseats)

datos.head(3)

| Sales | CompPrice | Income | Advertising | Population | Price | ShelveLoc | Age | Education | Urban | US | |

|---|---|---|---|---|---|---|---|---|---|---|---|

| 0 | 9.50 | 138 | 73 | 11 | 276 | 120 | Bad | 42 | 17 | Yes | Yes |

| 1 | 11.22 | 111 | 48 | 16 | 260 | 83 | Good | 65 | 10 | Yes | Yes |

| 2 | 10.06 | 113 | 35 | 10 | 269 | 80 | Medium | 59 | 12 | Yes | Yes |

Como Sales es una variable continua y el objetivo del estudio es clasificar las tiendas según si venden mucho o poco, se crea una nueva variable binaria (0, 1) llamada ventas_altas.

datos['ventas_altas'] = np.where(datos.Sales > 8, 0, 1)

# Una vez creada la nueva variable respuesta se descarta la original

datos = datos.drop(columns = 'Sales')

Ajuste y optimización de hiperparámetros¶

Se ajusta un árbol de clasificación empleando como variable respuesta ventas_altas y como predictores todas las variables disponibles. Se utilizan en primer lugar los hiperparámetros max_depth=5 y criterion='gini', el resto se dejan por defecto. Después, se aplica el proceso de pruning y se comparan los resultados frente al modelo inicial.

A diferencia del ejemplo anterior, en estos datos hay variables categóricas por lo que, antes de entrenar el modelo, es necesario aplicar one-hot-encoding. Puede encontrarse una descripción más detallada de este proceso en Machine learning con Python y Scikit-learn.

# División de los datos en train y test

# ==============================================================================

X_train, X_test, y_train, y_test = train_test_split(

datos.drop(columns = 'ventas_altas'),

datos['ventas_altas'],

random_state = 123

)

# One-hot-encoding de las variables categóricas

# ==============================================================================

# Se identifica el nobre de las columnas numéricas y categóricas

cat_cols = X_train.select_dtypes(include=['object', 'category']).columns.to_list()

numeric_cols = X_train.select_dtypes(include=['float64', 'int']).columns.to_list()

# Se aplica one-hot-encoding solo a las columnas categóricas

preprocessor = ColumnTransformer(

[('onehot', OneHotEncoder(handle_unknown='ignore', sparse_output=False, drop='if_binary'), cat_cols)],

remainder='passthrough',

verbose_feature_names_out=False

).set_output(transform="pandas")

# Una vez que se ha definido el objeto ColumnTransformer, con el método fit()

# se aprenden las transformaciones con los datos de entrenamiento y se aplican a

# los dos conjuntos con transform(). Ambas operaciones a la vez con fit_transform().

X_train_prep = preprocessor.fit_transform(X_train)

X_test_prep = preprocessor.transform(X_test)

X_train_prep.info()

<class 'pandas.core.frame.DataFrame'> Index: 300 entries, 170 to 365 Data columns (total 12 columns): # Column Non-Null Count Dtype --- ------ -------------- ----- 0 ShelveLoc_Bad 300 non-null float64 1 ShelveLoc_Good 300 non-null float64 2 ShelveLoc_Medium 300 non-null float64 3 Urban_Yes 300 non-null float64 4 US_Yes 300 non-null float64 5 CompPrice 300 non-null int64 6 Income 300 non-null int64 7 Advertising 300 non-null int64 8 Population 300 non-null int64 9 Price 300 non-null int64 10 Age 300 non-null int64 11 Education 300 non-null int64 dtypes: float64(5), int64(7) memory usage: 30.5 KB

Si bien RandomForestClassifier tiene valores por defecto para sus hiperparámetros, no se puede saber de antemano si estos son los más adecuados, la forma de identificarlos es mediante el uso de estrategias de validación, por ejemplo validación cruzada.

Los modelos Random Forest tienen la ventaja de disponer del Out-of-Bag error, lo que permite obtener una estimación del error de test sin recurrir a la validación cruzada, que es computacionalmente costosa. En la implementación de RandomForestClassifier, la métrica devuelta como oob_score es el accuracy, si se desea otra, se tiene que recurrir al método oob_decision_function_() para obtener las predicciones y con ellas calcular la métrica de interés. Para una explicación más detallada consultar: Grid search de modelos Random Forest con out-of-bag error y early stopping.

Cabe tener en cuenta que, cuando se busca el valor óptimo de un hiperparámetro con dos métricas distintas, el resultado obtenido raramente es el mismo. Lo importante es que ambas métricas identifiquen las mismas regiones de interés.

Aunque el análisis individual de los hiperparámetros es útil para entender su impacto en el modelo e identificar rangos de interés, la búsqueda final no debe hacerse de forma secuencial, ya que cada hiperparámetro interacciona con los demás. Es preferible recurrir a grid search o random search para analizar varias combinaciones de hiperparámetros. Puede encontrarse más información sobre las estrategias de búsqueda en Machine learning con Python y Scikit-learn.

Grid Search (out-of-bag score)¶

Más detalles en: Grid search de modelos Random Forest con out-of-bag error y early stopping.

# Grid de hiperparámetros evaluados

# ==============================================================================

param_grid = ParameterGrid(

{'n_estimators': [150],

'max_features': [5, 7, 9],

'max_depth' : [None, 3, 10, 20],

'criterion' : ['gini', 'entropy']

}

)

# Loop para ajustar un modelo con cada combinación de hiperparámetros

# ==============================================================================

resultados = {'params': [], 'oob_accuracy': []}

for params in param_grid:

modelo = RandomForestClassifier(

oob_score = True,

n_jobs = -1,

random_state = 123,

** params

)

modelo.fit(X_train_prep, y_train)

resultados['params'].append(params)

resultados['oob_accuracy'].append(modelo.oob_score_)

print(f"Modelo: {params} \u2713")

# Resultados

# ==============================================================================

resultados = pd.DataFrame(resultados)

resultados = pd.concat([resultados, resultados['params'].apply(pd.Series)], axis=1)

resultados = resultados.sort_values('oob_accuracy', ascending=False)

resultados = resultados.drop(columns='params')

resultados.head(4)

Modelo: {'criterion': 'gini', 'max_depth': None, 'max_features': 5, 'n_estimators': 150} ✓

Modelo: {'criterion': 'gini', 'max_depth': None, 'max_features': 7, 'n_estimators': 150} ✓

Modelo: {'criterion': 'gini', 'max_depth': None, 'max_features': 9, 'n_estimators': 150} ✓

Modelo: {'criterion': 'gini', 'max_depth': 3, 'max_features': 5, 'n_estimators': 150} ✓

Modelo: {'criterion': 'gini', 'max_depth': 3, 'max_features': 7, 'n_estimators': 150} ✓

Modelo: {'criterion': 'gini', 'max_depth': 3, 'max_features': 9, 'n_estimators': 150} ✓

Modelo: {'criterion': 'gini', 'max_depth': 10, 'max_features': 5, 'n_estimators': 150} ✓

Modelo: {'criterion': 'gini', 'max_depth': 10, 'max_features': 7, 'n_estimators': 150} ✓

Modelo: {'criterion': 'gini', 'max_depth': 10, 'max_features': 9, 'n_estimators': 150} ✓

Modelo: {'criterion': 'gini', 'max_depth': 20, 'max_features': 5, 'n_estimators': 150} ✓

Modelo: {'criterion': 'gini', 'max_depth': 20, 'max_features': 7, 'n_estimators': 150} ✓

Modelo: {'criterion': 'gini', 'max_depth': 20, 'max_features': 9, 'n_estimators': 150} ✓

Modelo: {'criterion': 'entropy', 'max_depth': None, 'max_features': 5, 'n_estimators': 150} ✓

Modelo: {'criterion': 'entropy', 'max_depth': None, 'max_features': 7, 'n_estimators': 150} ✓

Modelo: {'criterion': 'entropy', 'max_depth': None, 'max_features': 9, 'n_estimators': 150} ✓

Modelo: {'criterion': 'entropy', 'max_depth': 3, 'max_features': 5, 'n_estimators': 150} ✓

Modelo: {'criterion': 'entropy', 'max_depth': 3, 'max_features': 7, 'n_estimators': 150} ✓

Modelo: {'criterion': 'entropy', 'max_depth': 3, 'max_features': 9, 'n_estimators': 150} ✓

Modelo: {'criterion': 'entropy', 'max_depth': 10, 'max_features': 5, 'n_estimators': 150} ✓

Modelo: {'criterion': 'entropy', 'max_depth': 10, 'max_features': 7, 'n_estimators': 150} ✓

Modelo: {'criterion': 'entropy', 'max_depth': 10, 'max_features': 9, 'n_estimators': 150} ✓

Modelo: {'criterion': 'entropy', 'max_depth': 20, 'max_features': 5, 'n_estimators': 150} ✓

Modelo: {'criterion': 'entropy', 'max_depth': 20, 'max_features': 7, 'n_estimators': 150} ✓

Modelo: {'criterion': 'entropy', 'max_depth': 20, 'max_features': 9, 'n_estimators': 150} ✓

| oob_accuracy | criterion | max_depth | max_features | n_estimators | |

|---|---|---|---|---|---|

| 22 | 0.820000 | entropy | 20.0 | 7 | 150 |

| 13 | 0.820000 | entropy | NaN | 7 | 150 |

| 0 | 0.813333 | gini | NaN | 5 | 150 |

| 6 | 0.813333 | gini | 10.0 | 5 | 150 |

# Mejores hiperparámetros por out-of-bag error

# ==============================================================================

print("--------------------------------------------------")

print("Mejores hiperparámetros encontrados (oob-accuracy)")

print("--------------------------------------------------")

print(resultados.iloc[0,0:])

-------------------------------------------------- Mejores hiperparámetros encontrados (oob-accuracy) -------------------------------------------------- oob_accuracy 0.82 criterion entropy max_depth 20.0 max_features 7 n_estimators 150 Name: 22, dtype: object

Grid Search (validación cruzada)¶

# Grid de hiperparámetros evaluados

# ==============================================================================

param_grid = {

'n_estimators': [150],

'max_features': [5, 7, 9],

'max_depth' : [None, 3, 10, 20],

'criterion' : ['gini', 'entropy']

}

# Búsqueda por grid search con validación cruzada

# ==============================================================================

grid = GridSearchCV(

estimator = RandomForestClassifier(random_state = 123),

param_grid = param_grid,

scoring = 'accuracy',

n_jobs = cpu_count() - 1,

cv = RepeatedKFold(n_splits=5, n_repeats=3, random_state=123),

refit = True,

verbose = 0,

return_train_score = True

)

grid.fit(X=X_train_prep, y=y_train)

# Resultados

# ==============================================================================

resultados = pd.DataFrame(grid.cv_results_)

resultados.filter(regex='(param*|mean_t|std_t)') \

.drop(columns='params') \

.sort_values('mean_test_score', ascending = False) \

.head(4)

| param_criterion | param_max_depth | param_max_features | param_n_estimators | mean_test_score | std_test_score | mean_train_score | std_train_score | |

|---|---|---|---|---|---|---|---|---|

| 21 | entropy | 20 | 5 | 150 | 0.817778 | 0.028846 | 1.0 | 0.0 |

| 12 | entropy | None | 5 | 150 | 0.817778 | 0.028846 | 1.0 | 0.0 |

| 18 | entropy | 10 | 5 | 150 | 0.814444 | 0.030952 | 1.0 | 0.0 |

| 13 | entropy | None | 7 | 150 | 0.812222 | 0.027532 | 1.0 | 0.0 |

# Mejores hiperparámetros encontrados por validación cruzada

# ==============================================================================

print("--------------------------------------------")

print("Mejores hiperparámetros encontrados por (cv)")

print("--------------------------------------------")

print(grid.best_params_, ":", grid.best_score_, grid.scoring)

--------------------------------------------

Mejores hiperparámetros encontrados por (cv)

--------------------------------------------

{'criterion': 'entropy', 'max_depth': None, 'max_features': 5, 'n_estimators': 150} : 0.8177777777777779 accuracy

Una vez identificados los mejores hiperparámetros, se reentrena el modelo indicando los valores óptimos en sus argumentos. Si en el GridSearchCV() se indica refit=True, este reentrenamiento se hace automáticamente y

el modelo resultante se encuentra almacenado en .best_estimator_.

Predicción y evaluación¶

Por último, se evalúa la capacidad predictiva del modelo final empleando el conjunto de test.

# Modelo con los mejores hiperparámetros

# ==============================================================================

modelo_final = grid.best_estimator_

modelo_final

RandomForestClassifier(criterion='entropy', max_features=5, n_estimators=150,

random_state=123)In a Jupyter environment, please rerun this cell to show the HTML representation or trust the notebook. On GitHub, the HTML representation is unable to render, please try loading this page with nbviewer.org.

Parameters

| n_estimators | 150 | |

| criterion | 'entropy' | |

| max_depth | None | |

| min_samples_split | 2 | |

| min_samples_leaf | 1 | |

| min_weight_fraction_leaf | 0.0 | |

| max_features | 5 | |

| max_leaf_nodes | None | |

| min_impurity_decrease | 0.0 | |

| bootstrap | True | |

| oob_score | False | |

| n_jobs | None | |

| random_state | 123 | |

| verbose | 0 | |

| warm_start | False | |

| class_weight | None | |

| ccp_alpha | 0.0 | |

| max_samples | None | |

| monotonic_cst | None |

# Error de test del modelo final

# ==============================================================================

predicciones = modelo_final.predict(X=X_test_prep)

predicciones[:10]

array([0, 0, 0, 0, 0, 0, 1, 1, 1, 1])

mat_confusion = confusion_matrix(y_true=y_test, y_pred=predicciones)

accuracy = accuracy_score(y_true=y_test, y_pred=predicciones, normalize=True)

print("Matriz de confusión")

print("-------------------")

print(mat_confusion)